Download Estimador de máxima verosimilitud para la media poblacional

Document related concepts

Transcript

ESTADÍSTICA ESPAÑOLA

Vol. 44, Núm. 151, 2002, págs. 351 a 364

Estimador de máxima verosimilitud

para la media poblacional cuando el

diseño muestral asigna probabilidades

de selección proporcionales al tamaño

de la unidad

por

JESÚS BESCOS SINDE

Universidad de Castilla-La Mancha

RESUMEN

Este artículo muestra que es posible obtener un estimador de máxima verosimilitud (EMV) para la media poblacional de una población

finita, condicionado a un diseño muestral particular, usual en la práctica muestral. Tal diseño consiste en asignar a cada unidad poblacional

una probabilidad de selección proporcional a su tamaño (en términos

de la característica bajo estudio o alguna variable correlacionada). El

estimador obtenido es la media armónica muestral, del que se estudian su sesgo y varianza.

La idea básica subyacente al artículo es que la función paramétrica de verosimilitud puede depender de cómo se observan los datos.

Hacemos uso de este hecho para derivar el estimador propuesto.

Para finalizar, caracterizamos cierta situación donde el diseño

muestral (el modo cómo se observan los datos) es irrelevante para

función de verosimilitud eventual.

352

ESTADÍSTICA ESPAÑOLA

Palabras clave: Verosimilitud y diseño muestral/Estimadores de máxima verosimilitud.

Clasificación AMS: 62D05 Sampling Theory, Sample Surveys.

1. INTRODUCCIÓN

Este artículo está estructurado como sigue:

1. Es usual en la Teoría del muestreo en poblaciones finitas referir la notación a

las unidades elementales que componen la población. En lugar de centrarnos en

las unidades elementales, preferimos trabajar con la distribución de frecuencias

poblacional. La notación necesaria a tal fin se desarrolla en la primera parte de este

artículo.

2. Supongamos que estamos estudiando la composición demográfica de los hogares de una determinada región geográfica. Supongamos además que disponemos de esta información referida a un censo realizado en un momento anterior. Es

posible hacer uso de esta información complementaria a la hora de realizar el

diseño muestral, para asignar probabilidades de selección a las unidades poblacionales, de modo que obtengamos ganancias de precisión en las estimaciones

realizadas. La segunda parte del artículo analiza un diseño particular, empleado en

la práctica, que permite obtener un estimador concreto por máxima verosimilitud

para la media poblacional.

3. La tercera parte presenta una simulación con el fin de ilustrar los resultados

teóricos alcanzados en la segunda parte.

4. El cuarto apartado desarrolla el caso donde las probabilidades de selección

se asignan a través de una variable diferente a la estudiada. Como se razonará

más adelante, resulta ser el caso de mayor interés práctico.

5. El último apartado recoge las conclusiones principales.

2. PRELIMINARES

Es común en la Teoría del Muestreo en Poblaciones Finitas trabajar con las unidades individuales que conforman la población, habitualmente denotadas Ui.

Así, es usual representar la población a través de un vector de N (tamaño poblacional) unidades elementales (U1, U2, U3,......... Ui,......... UN) en cada una de las

cuales la característica estudiada, X, toma valores (X1, X2, X3,......... Xi......... XN),

donde el superíndice denota la unidad i.

ESTIMADOR DE MÁXIMA VEROSIMILITUD PARA LA MEDIA POBLACIONAL CUANDO EL DISEÑO MUESTRAL ASIGNA…

353

La variable X toma ‘k’ valores, donde k<=N, pues no puede haber más valores

que unidades individuales. Sea Xh el valor h de la variable X cuya frecuencia relativa poblacional es fh.

1

0

Sea IXh (Ui ) =

Es obvio que fh =

si

i

X

si

i

X

= Xh

≠ Xh

1 N

∑ I (U )

N i=1 Xh i

Por lo tanto, la distribución poblacional de frecuencias de la variable X se representará mediante un vector (X1 , X2 ,....Xh ,.....Xk) con sus correspondientes frecuencias (f1 , f2,....fh ,....fk).

A continuación mostramos como el muestreo probabilístico, i.e. la selección

aleatoria de unidades Ui, mediante la asignación a priori a cada unidad de una

determinada probabilidad de selección, denotada Pi, induce una estructura de

frecuencias aparente sobre los valores de X, que no coincide necesariamente con

la distribución poblacional de sus frecuencias (fh) .

Restringimos el análisis al muestreo aleatorio simple con reposición en sus dos

modalidades: probabilidades de selección iguales y desiguales.

Una vez que las probabilidades de selección, Pi, han sido asignadas, la probabilidad de observar el valor Xh en la muestra -probabilidad que denominamos frecuencia aparente de Xh y denotamos P(Observar Xh)-, se obtiene aplicando el

teorema de la probabilidad total:

[

N

P(Observar Xh )

]

= ∑ Pi * P Xi = Xh / Ui ∈ S

i=1

donde el condicionamiento se refiere a haber seleccionado la unidad Ui. Obsérvese que el suceso ‘Observar Xh’ significa ‘seleccionar Xh’ (valor h-ésimo de la

variable X) que, conviene recordar, no es lo mismo que ‘seleccionar Xi ‘ (valor de X

asociado a la unidad i-ésima) resulta inmediato que:

[

PX

i

= Xh

/ Ui

]

∈S = I X h (Ui )

puesto que la unidad Ui presenta (o no ) el valor Xh con probabilidad condicionada

0 o 1. Luego:

354

ESTADÍSTICA ESPAÑOLA

[

N

]

N

P(Observar X h ) = ∑ Pi * P X i = X h / Ui ∈S = ∑ Pi * I Xh (Ui )

i=1

Si las probabilidades de selección son iguales Pi =

i=1

(1)

1

, entonces:

N

N

1

* I Xh (Ui ) = fh

i=1 N

P(Observar X h ) = ∑

es decir, en el caso de probabilidades de selección iguales, las frecuencias aparentes coinciden con las frecuencias poblacionales. Cada una de las sucesivas

selecciones de la muestra tiene una estructura probabilística idéntica a la estructura

de frecuencias de la población.

Si se emplean probabilidades desiguales de selección (Pi ) las frecuencias aparentes no coinciden con las frecuencias poblacionales. Es como si se trabajase

sobre una población subyacente ‘diferente’.

3. ESTIMADOR DE MÁXIMA VEROSIMILITUD PARA LA MEDIA POBLACIONAL

Un caso interesante surge cuando se emplean probabilidades de selección de

modo que

Pi =

Xi

X

(1b)

siendo X el total poblacional de Xi.

Obsérvese que este es el esquema ideal de probabilidades de selección para

estimar la media poblacional a través del estimador lineal insesgado propuesto por

∧

Xi

N

i=1 nPi

n

Hansen y Hurwitz(1943), cuya expresión es θHH = ∑

Combinando (1) y (1b) obtenemos :

ESTIMADOR DE MÁXIMA VEROSIMILITUD PARA LA MEDIA POBLACIONAL CUANDO EL DISEÑO MUESTRAL ASIGNA…

N

N

P(Observar X h ) = ∑ Pi * I Xh (Ui ) = ∑

i =1

i=1

355

Xi

* I Xh (Ui )

X

∑X

Xi =Xh

=

= F1 (X h ) − F1 (X h−1 )

X

i

(2)

donde F1(Xh) es la proporción acumulada de la característica X hasta el valor Xh. En

otras palabras, bajo este esquema de muestreo, la frecuencia aparente de Xh se

puede obtener empleando la función de acumulación F1(X), como la función de

distribución de las probabilidades de selección

Puesto que el tamaño poblacional es N, se puede expresar el total poblacional,

X, como N veces la media poblacional -denotada θ- y, puesto que Nfh es el número

de unidades poblacionales que presentan el valor Xh, es posible expresar la frecuencia aparente como:

(

P Observar X h

)=

i

X

∑

i

X

=Xh

X

=

Nfh X h

Nθ

=

fh X h

θ

(3)

Esta expresión, al relacionar el parámetro θ con las probabilidades de observar

los distintos valores Xh, permite obtener un estimador mediante el método de

máxima verosimilitud para θ -l a media poblacional- como sigue:

Se puede imaginar el proceso de muestreo como una selección aleatoria repetida sobre una población multinomial con modalidades X1.....Xk y probabilidades de

selección dadas por las frecuencias aparentes Xhfh/θ . La expresión general de la

función de soporte (logaritmo de la función de verosimilitud) será:

K

(θ) = ∑ nh ln[ph (θ)]

S

h=1

Aquí nh es la frecuencia absoluta muestral y, ph(θ) la probabilidad -que hemos

identificado con las frecuencias aparentes- de cada modalidad, previamente denotada P(Observar Xh) .

Como es sabido, dada la muestra, el estimador de máxima verosimilitud para

ph(θ) es

∧

p h (θ)

=

nh

n

, siendo n el tamaño muestral. Una vez realizada la selección,

Xh es fijo y entonces

356

ESTADÍSTICA ESPAÑOLA

∧

ph (θ)

∧

∧

X f

f

= h h = Xh h

θ

θ

de modo que

∧

fh

Xh

=

θ

∧

nh

n

f

⇒ h =

θ

nh

nXh

∧

∑ fh = 1

(4)

pero, dada la restriccion

h

k

∧

∧

f 1 k n

∑ θh = ∧ =∑ nXh ⇒ θ =

h=1

θ h=1 h

n

k

1

∑X

h=1

h

nh

Hemos obtenido el estimador para la media poblacional, θ, cuando el esquema

muestral emplea probabilidades de selección proporcionales al tamaño de cada

unidad (en términos de la característica bajo estudio). Queremos destacar que el

estimador es la media armónica muestral, y no contiene las probabilidades de

selección.

Hemos alcanzado el resultado anterior, estableciendo las probabilidades de selección según (1b). No obstante, el estimador propuesto puede ser útil incluso en el

caso de desconocer el total poblacional, como fue sugerido por un evaluador

anónimo en una versión previa de este artículo. Consideremos, por ejemplo, el

muestreo sobre una región agrícola para determinar la superficie media de cultivo

de las fincas. Si el muestreo es espacialmente uniforme, las probabilidades de

selección resultan proporcionales al tamaño de las unidades.

A fin de evaluar el sesgo y la varianza en el muestreo del estimador, comencemos por evaluar estas características referidas al inverso del estimador. Esto es:

∧

θ=

1

∧

S

y

∧

S

=

k

1

1

∑X

n

h=1

h

nh

En primer lugar

1 k 1

= E ∑

nh =

n h=1 Xh

∧

E S

1

k

1

∑X

n

h=1

h

E(nh )

=

1

k

1

∑X

n

h=1

h

nph

=

1

k

1

∑X

n

h=1

h

n

X f fh

θ

=

1

n

k

f

∑ θh

n

h=1

=

1

θ

(5)

ESTIMADOR DE MÁXIMA VEROSIMILITUD PARA LA MEDIA POBLACIONAL CUANDO EL DISEÑO MUESTRAL ASIGNA…

357

La varianza se obtiene empleando las propiedades de la distribución multinomial:

1 k 1

∧

V ∑

=

S

n X nh =

h=1 h

V

1

2

k

∑

1

− +

2 nph (1 ph )

n h=1 Xh

1

2

1

k

1

1

k

1

Cov(nh ,nl ) =

2∑

2 V(nh )+ 2 ∑

X X

n

n

X

h=1

k

∑

1

n h≠ l XhXl

h≠l

h

h l

(−nphpl )

utilizando (3) y agrupando convenientemente, se llega a:

∧

S =

V

1

1

−

θ

nθ H

1

(6)

donde H es la media armónica poblacional de la característica X.

∧

Expandiendo 1 S en serie de Taylor hasta orden 2 alrededor de 1/θ

∧

θ=

1

∧

S

2

1

1

∧

∧

= θ −θ2 S − + θ3 S − + R

θ

θ

(7)

Despreciando los términos contenidos en R, tomando esperanzas en (7), combinadas con los resultados (5) y (6)

1

1

1

∧

∧

= E( ∧ ) ≈ θ − θ2 E S − + θ3 E S −

θ

θ

S

∧

E θ

2

(8)

∧

θ2 1 1

1

∧

3

E θ = E( ) ≈ θ + θ V S = θ +

−

∧

θ

n H

S

Lo que prueba que el estimador MV es insesgado para muestras de gran tamaño, pues el sesgo asintótico es nulo

limn→ ∞

θ2 1 1

− =

θ

n H

0

La varianza en el muestreo del estimador se puede obtener empleando de nuevo la expansión en serie de Taylor (7), esta vez hasta primer orden, para llegar a:

358

ESTADÍSTICA ESPAÑOLA

∧

θ=

1

∧

S

1

∧

= θ − θ2 S − + R'

θ

1

∧

θ − θ ≈ θ2 S −

θ

∧

2

∧

1

∧

4

θ − θ ≈ θ S −

θ

2

Tomando esperanzas y considerando un tamaño muestral suficientemente

grande para despreciar el sesgo -en caso contrario el resultado siguiente se referiría el Error Cuadrático medio del estimador- obtenemos:

∧

∧

θ ≈ θ4 V(S) = θ4

V( )

3

2

1 1 θ 1 1 θ θ

− =

− =

− 1

θ n H θ n H

nθ H

1

(9)

La varianza del estimador depende de la proporción en que θ excede a H.

∧

Puesto que θ es asintóticamente insesgado y su varianza converge a 0 a medida que n aumenta, θ es consistente en probabilidad.

El error de muestreo -la desviación típica del estimador- será menor que el correspondiente al del estimador en el muestreo aleatorio simple con probabilidades

de selección iguales, siempre que1:

θ

n

σ

θ

− 1 ≤

H

n

donde σ es la desviación típica poblacional de X. Reordenando la expresión anterior:

θ σ

θ

2

2

− 1 ≤ ⇒ − 1 ≤ (CVx ) ⇒ θ ≤ (1 + (CVx ) )H

H θ

H

(10)

i.e. el estimador propuesto para θ, mejora a su homólogo con probabilidades de

selección iguales, cuando la distancia entre la media poblacional y la media armónica poblacional, no exceda cierta magnitud, que puede expresarse en términos de

1 Recuérdese que el estimador para la media poblacional en el caso de probabilida2

des iguales de selección es la media muestral, cuya varianza en el muestreo es σ /n,

2

donde σ es la varianza poblacional de X.

ESTIMADOR DE MÁXIMA VEROSIMILITUD PARA LA MEDIA POBLACIONAL CUANDO EL DISEÑO MUESTRAL ASIGNA…

359

la variabilidad relativa de la característica X a través de su coeficiente de variación

(CV) .

4. UN CASO SIMULADO.

A fin de ejemplificar los resultados teóricos alcanzados en la sección anterior,

realizamos ahora una simulación sencilla comparando el Error Cuadrático Medio de

los dos procedimientos de estimación de la media poblacional: probabilidades

iguales de selección y probabilidades de selección dadas por (1.b).

Sea X la característica bajo estudio con valores {10,20,30,40,50,200} y frecuencias poblacionales {10/62,20/62,15/62,10/62,5/62,10/62,2/62}.(Nótese que se

trabaja directamente con la distribución de frecuencias poblacional de X y no con

las unidades individuales)

Resulta fácil comprobar que

θ = 33,0645

H

= 21,8695

(11)

2

σ = 1092,22 σ = 33,0488

Esto es, se satisface la condición (10) de modo que el esquema de muestreo

con probabilidades de selección dadas por (1.b) debe mejorar a su análogo con

probabilidades iguales de selección.

Para cada tamaño muestral (n) entre 2 y 65 se generaron 60 vectores aleatorios

(n números reales del intervalo [0,1]) que se compararon: en primer lugar con la

j

función de distribución {F1 , F2, ..Fj.. Fk-1,1} - donde Fj = ∑ f i -

lo que permite

i =1

obtener la muestra aleatoria con probabilidades iguales de selección y, en segundo

lugar, con la distribución acumulada de probabilidades {p1, p1+p2,........1} -pi definida en (3)- de forma que se obtiene la muestra con probabilidades de selección

dadas por (1b).

La simulación confirma los resultados alcanzados por consideraciones teóricas,

el EMV de θ mejora a su homólogo con probabilidades iguales, siendo alrededor de

2 veces más eficiente en términos de su Error Cuadrático Medio (que equivale a la

varianza en muestra suficientemente grandes que permitan despreciar el sesgo).

Esta medida de la eficiencia relativa podría haberse anticipado considerando el

cociente de las varianzas de los estimadores θ 2 [(θ H) − 1] σ 2 particularizado a los

datos (11).

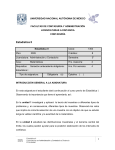

Los resultados de la simulación se resumen en la tabla siguiente. Las columnas

2ª y 3ª muestran, respectivamente el Error Cuadrático Medio del Estimador en los

casos A: Probabilidades de selección dadas por (1.b), y B: Probabilidades de

360

ESTADÍSTICA ESPAÑOLA

selección iguales. El Error Cuadrático Medio y es Sesgo se adjetivan “empíricos”

porque se determinaron a partir de la distribución en el muestreo del estimador en

60 muestras independientes para cada tamaño muestral considerado. La 4ª columna se obtiene como cociente de los errores cuadráticos medios.

Las dos últimas columnas recogen el sesgo correspondiente a ambos procedimientos de estimación. Es evidente que en el caso A el sesgo converge a 0 a

medida que aumenta el tamaño muestral.

Tamaño

muestra

2

3

4

5

6

7

8

9

10

11

12

13

14

15

20

25

35

45

55

65

ECM empírico

60 muestras

Eficiencia

Sesgo empírico

60 muestras

A. Pi (1b)

B. Pi iguales

(A/B)*100

C. Pi (1b)

D. Pi Iguales

403,94

289,40

155,16

276,44

167,68

119,49

153,99

148,17

62,70

80,40

50,50

44,84

63,07

59,97

27,88

24,18

21,77

15,82

8,18

7,07

669,30

274,26

147,71

171,56

109,08

110,78

253,85

119,98

107,89

118,75

70,23

63,46

101,78

66,61

51,15

43,90

28,17

27,13

16,81

14,93

60,35%

105,52%

105,04%

161,13%

153,73%

107,86%

60,66%

123,50%

58,12%

67,70%

71,91%

70,66%

61,97%

90,03%

54,51%

55,07%

77,28%

58,33%

48,68%

47,38%

7,58

5,81

3,49

3,33

2,69

2,59

4,72

2,33

0,37

1,71

1,18

1,38

1,54

1,70

0,50

-0,14

0,55

0,18

0,42

-0,28

1,69

-1,73

-2,94

-2,96

-1,45

-1,85

3,41

-1,06

-1,56

0,21

-0,22

-0,85

0,94

0,45

-1,06

-0,40

-0,10

0,04

0,34

-0,30

5. ASIGNADO PROBABILIDADES DE SELECCIÓN A TRAVÉS DE UNA TERCERA VARIABLE

Antes de finalizar, debemos estudiar el efecto del esquema de muestreo (1b)

cuando estamos interesados en estimar la media poblacional de otra característica,

digamos Y. Tal será el caso de mayor interés práctico, pues podemos hacer uso de

la información suplementaria disponible sobre X para mejorar nuestras estimaciones sobre Y.

ESTIMADOR DE MÁXIMA VEROSIMILITUD PARA LA MEDIA POBLACIONAL CUANDO EL DISEÑO MUESTRAL ASIGNA…

361

La característica Y tendrá una distribución de frecuencias sobre la población tomando valores (Y1 , Y2 ,....Yj ,.....,Ym) con frecuencias respectivas (fy1 , fy2,....fyj

,...,,.fym) -el subíndice y se emplea para evitar la confusión con las frecuencias de

X, denotadas fh. Puesto que no hay razón para que las características X e Y deban

presentar el mismo número de modalidades, suponemos k#m.

Con probabilidades de selección dadas por (1b), la probabilidad de observar Yj

(su frecuencia aparente) será:

N

N

P(Observar Yj ) = ∑ Pi * I Y (Ui ) = ∑

j

i=1

i=1

Xi

∑

i

Y =Yj

X. j

Xi

* I Y (Ui ) =

=

X

X

X

j

Donde X.j es el total poblacional de X condicionado a Yj, i.e.: total de X en manos de las unidades que presentan la modalidad Yj. Considerando que el número

de unidades poblacionales que presentan Yj es Nfyj , y denotando por x. j la correspondiente media condicionada, podemos escribir:

P(Observar Yj ) =

Nfyj x. j

Nθ

(12)

Supongamos ahora que ambas variables (X e Y) están relacionadas de modo

que el lugar geométrico de las medias condicionadas de X a los distintos valores de

Y es lineal. Es decir la curva de regresión x/y is x. = a + bY . Consecuentemente

θ = a + bθ , donde la letra θ denota la media poblacional y el subíndice se refiere

a la característica en cuestión (X o Y). Sustituyendo convenientemente

j

x

j

y

P(Observar Yj ) =

Nfy j x. j

Nθ x

=

Nfy j (a + bYj )

N(a + bθ y )

Si a=0 es obvio que:

(

P Obs. Yj

)=

NfyjbYj

θ

Nb

y

=

fyjYj

θ

y

La anterior expresión, referida a Yj es análoga a (3) - referida a Xh - y hemos

concluido que el EMV de θy es homólogo al obtenido para θx en (4). Por supuesto,

las expresiones para el sesgo y la varianza en el muestreo del estimador de θy son

362

ESTADÍSTICA ESPAÑOLA

análogas a las del estimador de θx - (8) y (9) - realizando las sustituciones pertinentes.

El estimador obtenido para la media ( o total ) poblacional de cualquier característica Y, puede emplearse siempre que dispongamos de información acerca de

una variable linealmente correlacionada (con a=0), que nos capacite para definir las

probabilidades de selección Pi del modo (1b)

6. CONCLUSIONES

La función de verosimilitud paramétrica es una relación funcional que liga ciertos

parámetros con las observaciones realizadas a través de la estructura de probabilidades que las genera. Este artículo presenta un ejemplo de cómo esta idea básica

puede aplicarse para la obtención de una estimador MV en una situación particular:

la estimación de la media poblacional cuando se dispone de información suplementaria que nos capacita para establecer las probabilidades de selección como

(1b)

Al mismo tiempo, los resultados de la sección 3 nos permiten una comprensión

mejor de la irrelevancia (o no ) del diseño muestral sobre la función de verosimilitud.

La expresión (12)

P(Observar Y ) =

Nf x.

yj

j

Nθ

j

se puede reescribir, en el caso de que X e Y sean estadísticamente independientes

-las medias condicionadas de X a los diferentes valores de Y serían iguales a la

media poblacional θx - como

P(Observar Y ) = f

j

yj

Bajo el diseño muestral (1b) e independencia estadística entre X e Y, las frecuencias aparentes de los valores de Y son iguales a sus frecuencias poblacionales. Por tanto, si pudiésemos especificar una relación paramétrica ligando Yj con fyj ,

el diseño muestral (1b) sería irrelevante para la verosimilitud de los parámetros

contenidos eventualmente en tal especificación.

ESTIMADOR DE MÁXIMA VEROSIMILITUD PARA LA MEDIA POBLACIONAL CUANDO EL DISEÑO MUESTRAL ASIGNA…

363

REFERENCIAS

BASU, D. (1969) «Role of the sufficiency and likelihood principles in sample survey

theory» Sankhya, Serie A, Vol 31

EDWARDS, A. (1972) «Likelihood» Cambridge University Press.

HANSEN, M. & HURWITZ, W, (1943) «On the theory of sampling from finite population».

Ann. Math. Star Vol 14.

HANSEN, M., HURWITZ, W

Theory» John Wiley.

AND

MADOW W.(1956) «Sample survey Methods and

ROYALL R.M. (1997) «Statistical Evidence» Chapman & Hall

STUART, A. (1962) «Basic Ideas of Scientific Sampling» Griffin’s statistical monographs & courses.2

364

ESTADÍSTICA ESPAÑOLA

MAXIMUM LIKELIHOOD ESTIMATOR FOR POPULATION MEAN

WHEN SAMPLE DESIGN ASSIGNS SELECTION PROBABILITIES

PROPORTIONAL TO UNIT SIZE

SUMMARY

This paper shows that is possible to obtain a maximum likelihood

estimator (MLE) for the population mean of finite population conditioned to a particular sampling design commonly used in sampling

practice. Sampling design which assigns to each population unit a selection probability proportional to unit’s size (in terms of the characteristic under study or some correlated variable). This estimator is the

sample harmonic mean. Estimator’s sampling bias and variance are

discussed.

The basic idea underlying this paper is that parametric likelihood

function may depend on the way we observe the data. We make use

of this fact to derive the estimator here proposed.

At the end, we characterise certain situation where sampling design (the way we observe the data) is irrelevant to the eventual likelihood function.

Keywords: Likelihood and sampling design/Maximum likelihood estimators.

AMS Classification: 62D05 Sampling Theory, Sample Surveys.